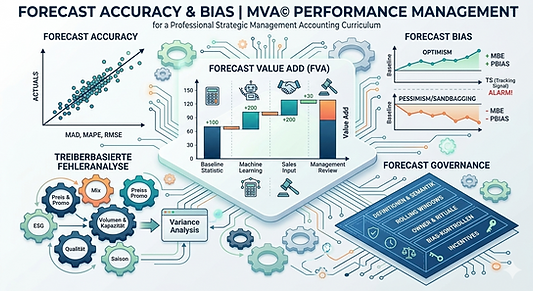

Forecast Accuracy / Forecast Bias

Deutsch: Prognosegenauigkeit / Prognoseverzerrung

Status: Core Capability im Performance Management, S&OP (Sales & Operations Planning), Rolling Forecast, APM/PM (Advanced/Performance Management)

Definition

Forecast Accuracy (Prognosegenauigkeit) misst, wie nah eine Prognose (Forecast) an der späteren Realität (Actuals) liegt. Forecast Bias (Prognoseverzerrung) misst, in welche Richtung Prognosen systematisch danebenliegen (z. B. tendenziell zu hoch = Optimismus, tendenziell zu niedrig = Pessimismus/Sandbagging).

Beides zusammen beantwortet die zwei Kernfragen:

„Wie gut ist unsere Vorhersagefähigkeit?“

„Ist der Fehler zufällig – oder steckt ein Muster (Bias) dahinter?“

1) Executive Summary

Warum wichtig? Forecast Accuracy & Bias sind der Taktgeber für Kapazitätsplanung, Working Capital, Preis‑/Promo‑Politik, Produktionslosgrößen, Service‑Level, Cash‑ und Liquiditätsplanung, Investor Relations und Bonus/OKR‑Systeme.

Accuracy ohne Bias‑Analyse ist gefährlich: Ein „guter“ Durchschnittswert kann schlechte systematische Fehler verdecken.

NextLevel‑Ansatz:

Governance‑first (Definitionen, Owner, Zeitfenster, Versionierung)

Treiberlogik statt reine Statistik (Preis, Mix, Saison, Kampagnen, Kapazität, Engpass)

Forecast Value Add (FVA) zur Bewertung, welcher Prozess/Layer die Prognose wirklich verbessert.

Ergebnis: Präzisere Entscheidungen, weniger Zielkonflikte, schnelleres Lernen.

2) Wo Forecast Accuracy & Bias wirken (Impact‑Karte)

S&OP / Demand Planning: Service‑Level, Bestände (Sicherheitsbestand), Obsoleszenz, Losgrößen.

Finance / Rolling Forecast: EBIT/EBITDA‑Trefferquote, Cash‑Plan, Covenants, Guidance.

Supply Chain / Operations: Kapazitätsbelegung, Overtime, Outsourcing, Engpasssteuerung.

Sales & Marketing: Kampagnen‑Timing, Preiselastizität, Mix‑Steuerung.

HR/Workforce: Schichtplanung, Hiring‑Freeze/‑Ramp‑Up.

IT/Cloud: Workload‑Provisioning, Kosten/Minute (TDABC), Performance‑Sicherheit.

3) Die mathematische Logik (Wix‑kompatibel)

3.1 Grundgrößen

Forecast_t = prognostizierter Wert in Periode t

Actual_t = realisierter Wert in Periode t

Error_t = Actual_t - Forecast_t

AbsError_t = |Error_t|

RelError_t = (AbsError_t) / max(Actual_t, ε) # ε small > 0, um Division durch 0 zu vermeiden

3.2 Genauigkeitsmaße (Accuracy)

MAPE (Mean Absolute Percentage Error) – leicht interpretierbar:

MAPE = (1/n) * Σ_t [ Abs(Actual_t - Forecast_t) / max(Actual_t, ε) ]

MAD (Mean Absolute Deviation) – robust gegen Ausreißer in Prozenten:

MAD = (1/n) * Σ_t [ |Actual_t - Forecast_t| ]

RMSE (Root Mean Squared Error) – bestraft große Fehler stärker:

RMSE = sqrt( (1/n) * Σ_t [ (Actual_t - Forecast_t)^2 ] )

sMAPE (symmetrische MAPE) – bei Nullen/kleinen Werten stabiler:

sMAPE = (1/n) * Σ_t [ |Forecast_t - Actual_t| / ((|Forecast_t| + |Actual_t|)/2) ]

3.3 Verzerrungsmaße (Bias)

Mean Bias Error (MBE) – Richtung des Fehlers:

MBE = (1/n) * Σ_t [ Actual_t - Forecast_t ] # >0 = tendenziell zu niedrig prognostiziert

Percent Bias (PBIAS) – Richtung in %:

PBIAS = 100 * [ Σ_t (Actual_t - Forecast_t) / max(Σ_t Actual_t, ε) ]

Tracking Signal (TS) – Bias vs. Streuung (MAD):

TS = (Σ_t Error_t) / max(MAD, ε)

# Richtwert: |TS| <= 4 gilt oft als "in Kontrolle"; außerhalb → Bias-Alarm

3.4 Rolling Accuracy Window (Bewegtes Fenster)

Rolling_MAPE_k = MAPE berechnet über die letzten k Perioden

# typische k: 6, 12 oder 24 (je nach Zyklus/Saisonalität)

3.5 Forecast Value Add (FVA)

Idee: Misst, ob ein Schritt im Prozess die Prognose verbessert oder verschlechtert – verglichen mit einer naiven Basis (z. B. „Vorperiode“ oder „gleiche Periode Vorjahr“).

FVA(step) = Accuracy(Basis) - Accuracy(nach_step)

# Positiv = Mehrwert; Negativ = Verschlechterung durch den Step

# Accuracy kann MAPE, MAD oder RMSE sein (konsistent bleiben!)

4) Forecast Bias – die 8 häufigsten Muster (Erkennungsleitfaden)

Over‑Optimism Bias (Optimismus) – Forecast > Actual → systematisch zu hoch. Ursachen: Überambitionierte Ziele, politischer Druck, Bonus‑Struktur.

Conservatism / Sandbagging (Pessimismus) – Forecast < Actual → systematisch zu niedrig.Ursachen: „Ziele sicher erreichen“, Puffermentalität.

Anchoring Bias (Anker) – Festhalten an der ersten Zahl trotz neuer Evidenz.Ursachen: Status quo, Hierarchie‑Effekte.

Trend Bias – Trends werden überschätzt/ignoriert.Ursachen: Überreaktion auf kurzfristige Bewegungen oder Trägheit.

Seasonality Bias (Saisonalität) – Muster nicht korrekt erfasst.Ursachen: Kalender‑Effekte, bewegliche Feiertage, Wetter.

Campaign/Promo Bias – Kampagneneffekte falsch antizipiert.Ursachen: Nichtlineare Elastizitäten, Kannibalisierung, Lag‑Effekte.

Supply‑Constrained Bias – Nachfrage wird an Verfügbarkeit „festgenagelt“.Ursachen: Engpass → „Wir planen, was wir liefern können“, nicht die echte Nachfrage.

Last‑Minute Bias – kurzfristige, politisch motivierte Anpassungen vor dem Cut‑off.Ursachen: Meeting‑Theater, „Management‑Expectation“.

Diagnostik: Kombiniere TS, PBIAS und Segment‑Drill‑downs (Produkt, Region, Kanal, Kunde) mit Zeitfenstern (k‑Rolling). Bias ist oft segment‑spezifisch.

5) Was ist „gute“ Forecast Accuracy?

Segment‑abhängig: Volatilität, Lebenszyklus, Preisstellung, Promo‑Intensität, Datenlage.

Richtwerte (praxisnah, nicht dogmatisch):

Reife, stabile Serien: MAPE 5–15 %

Rauschanfällig (Mode, Elektronik, Kampagnen): MAPE 15–35 %

Neue Produkte/Launches: MAPE 30–60 % (Phase‑down: Sollwerte anpassen)

Wichtiger als absolute Zielwerte: Bias‑Freiheit und kontinuierliche Verbesserung (FVA↑).

6) Treiberbasierte Fehleranalyse (NextLevel‑Modell)

Warum? Reine Fehlerstatistik erklärt nicht die Ursachen. Wie? Mappe Fehler auf Treiber – so wird es steuerbar.

Treiber‑Cluster (Beispiele):

Preis & Promo: Preiselastizität, Rabattstaffeln, Kampagnenkalender, Wettbewerbsreaktionen.

Mix: Produkt‑/Kanal‑/Kundenmix, Kannibalisierung, Substitution.

Volumen & Kapazität: Engpässe (Throughput Accounting), praktische Kapazität (TDABC).

Qualität & Yield: Ausschuss, Nacharbeit, First‑Pass‑Yield.

Saison: Kalender, Wetter, Ferien, bewegliche Feiertage.

ESG/Externe: Regulatorik, Lieferkette, Energiepreise, außergewöhnliche Ereignisse.

Verknüpfung zur Variance Analysis:

Forecast_Error = Preis_Effekt + Mengen_Effekt + Mix_Effekt + Kapazitäts_Effekt + Saison_Effekt + ...

→ Erlaubt kausale Brücken (Executive Bridges) und konkrete Maßnahmen.

7) Forecast Governance – das NextLevel‑Betriebsmodell

Definitionen & Semantik‑Layer: Einheitliche Formeln, Zeitfenster, Aggregationsebenen; Data Catalog & Owner.

Rolling Windows & Versionierung: Forecast_v1, v2, v3 …; Lock‑Termine; Änderungslog.

Owner & Rituale: Finance/SCM/Sales besitzen Teilprognosen; gemeinsamer Performance‑Dialog (Bridge → RCA → Maßnahme → Forecast‑Impact).

Bias‑Kontrollen: Tracking Signal, PBIAS‑Grenzen, Segment‑Drilldowns.

FVA‑Denke: Jeder Layer (Statistik, Maschine, Mensch) muss Mehrwert liefern – sonst streichen.

Tooling & Daten: BI‑Dashboards, Planner, Feature Store (für ML‑Features), Audit Trail.

Incentives: Boni an Bias‑freie Accuracy koppeln (gewichtete Ziele, keine Silo‑Anreize).

Schulung: Forecast‑Methoden, Bias‑Awareness, Treiberlogik (ACCA/CIMA‑kompatibel).

8) Case Study – „Helvetic Appliances AG“

Kontext: Premium‑Haushaltsgeräte, starker Winter‑Peak, Retail + Direct‑to‑Consumer (D2C). Problem: MAPE im Weihnachtsquartal bei 28 %, Kundenservice überlastet, hohe Overtime.

Setup:

Demand‑Forecast je Woche;

Promo‑Kalender;

Kapazitätsmodell (TDABC) mit praktischer Kapazität 82 %;

Executive Bridge bis EBIT.

Analyse:

Bias: PBIAS +7 % (konservativ/sandbagging) im Retail‑Kanal; D2C neutral.

Treiber: Promo‑Lags falsch, Substitution zwischen zwei Premiumserien ignoriert.

FVA: Menschlicher „Co‑Adjust“ verschlechtert die statistische Basis (FVA negativ).

Maßnahmen:

Promo‑Features re‑modelliert (Lag + Kannibalisierung);

D2C‑Signal als Leading Indicator für Retail genutzt;

Bias‑Kontrolle (TS‑Grenzen) + Anreizsystem angepasst;

Kapazitäts‑„Surge Plan“ (temporäre Zusatzschichten nur bei TS‑Alarm).

Ergebnis (2 Quartale):

Rolling MAPE 28 % → 15 %;

PBIAS ~ 0 %;

Overtime‑Kosten −22 %;

Service‑Level +6 pp;

EBIT‑Bridge: Promo‑Trefferquote als expliziter Treiber sichtbar.

9) Dashboard‑Blueprint (BI‑fähig)

Accuracy & Bias Cockpit

Rolling MAPE/MAD/RMSE je Segment

PBIAS, Tracking Signal (Heatmap)

Outlier‑Detection (Anomalien)

FVA‑View

Basis vs. Statistik vs. Mensch vs. Konsens

Mehrwert je Layer (positiv/negativ)

Treiber‑Drill

Preis/Mix/Promo/Saison

Engpass & Kapazität (TA/TDABC)

Qualitäts‑/Yield‑Einfluss

Bridge & Maßnahmen

Executive Bridge (Forecast‑Fehler → EBIT)

Maßnahmen‑Backlog, Owner, ETA, Forecast‑Impact

10) ACCA‑Integration – wo es andockt (SBL, PM/APM)

ACCA Performance Management (PM) / Advanced Performance Management (APM): Forecast‑KPIs, Variance Analysis, Driver‑Based Planning, Szenariotechnik, Performance Measurement Systems.→ Accuracy/Bias sind Pflichtkompetenzen für Prognose‑ und Steuerungsqualität.

ACCA Strategic Business Leader (SBL):Governance, Entscheidungsqualität, Stakeholder‑Kommunikation (Guidance), Ethik (Anti‑Manipulation/Sandbagging).→ Bias‑Kontrollen & FVA sind Best Practices für verantwortungsvolle Führung.

ACCA‑Prüfungsvorbereitung (Praxis‑Tipp):

Definitionen & Formeln sicher beherrschen (MAPE, MAD, RMSE, PBIAS, TS, FVA).

Interpretation: Mindestens 2 Ursachen + 2 Maßnahmen je Fehlerbild nennen.

Governance: Owner‑Modell, Versionierung, FVA, Bias‑Grenzen.

11) NextLevel‑Statement

Forecast Accuracy ohne Bias‑Kontrolle ist Statistik – mit Bias‑Kontrolle wird sie zur Führungskompetenz. Wer Prognosen als lernendes System versteht, koppelt Treiberlogik, Governance und FVA‑Denke: Jede Anpassung muss Mehrwert liefern, jede Abweichung braucht Ursache & Maßnahme, und jede KPI ist klar definiert. So werden Forecasts verlässlich, fair und entscheidungsstark – und die Organisation resilienter.

12) FAQs – SEO‑stark & praxisnah

F1: Was ist der Unterschied zwischen Accuracy und Bias? Accuracy misst die Größe des Fehlers (wie weit daneben), Bias die Richtung (systematisch zu hoch/zu niedrig).

F2: Welches Accuracy‑Maß ist „das beste“? Kommt auf den Anwendungsfall an: MAPE ist gut interpretierbar, RMSE bestraft Ausreißer stärker, MAD ist robust. Wichtig ist Konsistenz im Vergleich.

F3: Was gilt als „guter“ MAPE‑Wert? Je nach Segment 5–35 %; entscheidend ist Bias‑Freiheit und Verbesserung über Zeit (Rolling‑Fenster). Neue Produkte haben anfangs deutlich höhere MAPE.

F4: Wie erkenne ich Bias schnell? Tracking Signal (TS) und PBIAS über Rolling‑Fenster. |TS| > 4 oder PBIAS deutlich ≠ 0 → Bias‑Alarm; danach Segment‑Drilldown.

F5: Was ist Forecast Value Add (FVA)? Ein Maß, ob ein Prozess‑Schritt (z. B. menschliche Anpassung) die Genauigkeit verbessert. Negative FVA → weglassen oder neu designen.

F6: Wie reduziert Rolling Forecast den Bias? Durch häufigere Updates, kürzere Horizonte, aktuelle Treiber und Versionierung – weniger „Set‑and‑forget“, mehr Lernen.

F7: Welche Rolle spielen Saisonalität und Kampagnen? Oft die Hauptursachen für Fehler. Nutze Kalender‑Features, Lag‑Variablen, Kannibalisierung und Mix in Modellen; pflege Promo‑Kalender diszipliniert.

F8: Was hat Accuracy mit Bonus zu tun? Ohne Vorsicht führt Bonus zu Sandbagging. Besser: Bias‑freie Accuracy als Ziel, kombiniert mit Treiber‑KPIs und FVA‑Kontrollen.

F9: Wie starte ich pragmatisch?

Definitionen festlegen, 2) Basis & Statistik messen, 3) Bias‑Grenzen setzen, 4) FVA prüfen, 5) Treiber ergänzen, 6) Rituale verankern.

F10: Welche Tools eignen sich? Beliebige BI/Planning‑Stacks. Wichtig sind Semantik‑Layer, Owner, Versionierung, Data Lineage und Drilldowns.

13) Copy‑Ready (Wix/Markdown) – Formeln kompakt

Error_t = Actual_t - Forecast_t

MAPE = (1/n) * Σ_t [ |Actual_t - Forecast_t| / max(Actual_t, ε) ]

MAD = (1/n) * Σ_t [ |Actual_t - Forecast_t| ]

RMSE = sqrt( (1/n) * Σ_t [ (Actual_t - Forecast_t)^2 ] )

sMAPE = (1/n) * Σ_t [ |Forecast_t - Actual_t| / ((|Forecast_t| + |Actual_t|)/2) ]

MBE = (1/n) * Σ_t [ Actual_t - Forecast_t ]

PBIAS(%) = 100 * [ Σ_t (Actual_t - Forecast_t) / max(Σ_t Actual_t, ε) ]

TS = (Σ_t Error_t) / max(MAD, ε)

FVA(step) = Accuracy(Basis) - Accuracy(nach_step)